یک زوج کالیفرنیایی از شرکت OpenAI به اتهام «مرگ غیرعمد» شکایت کردند؛ آنها ادعا میکنند که چتبات هوش مصنوعی این شرکت، ChatGPT، پسر ۱۶ ساله آنها را به گرفتن جان خود تشویق کرده است. این دادخواست بحثهای جدی را درمورد مسئولیتپذیری، ایمنی و تأثیرات روانی این فناوری قدرتمند بر کاربران آسیبپذیر برانگیخته است.

به گزارش BBC، پرونده جدید توسط «مت» و «ماریا رین» (Matt and Maria Raine) والدین «آدام رین» تنظیم شده است و OpenAI و مدیرعامل آن، «سم آلتمن»، را به سهلانگاری و عرضه محصول معیوب متهم میکند.

براساس دادخواست آنها، «آدام» که در ماه آوریل جان خود را از دست داد، ابتدا از ChatGPT برای کمک به تکالیف مدرسه و کشف علایقش استفاده میکرد. اما در عرض چند ماه «ChatGPT به نزدیکترین همدم این نوجوان تبدیل شد» و آدام شروع به صحبت درباره اضطراب و مشکلات روانی خود با این هوش مصنوعی کرد.

خودکشی پسر ۱۶ ساله با تشویق ChatGPT

خانواده رین ادعا میکنند که از ژانویه ۲۰۲۵ پسرشان شروع به بحث درمورد روشهای خودکشی با ChatGPT کرده بود و این برنامه نهتنها او را از این کار منصرف نکرده، بلکه روشهای مختلف را نیز در اختیار او قرار داده است. در بخشی از دادخواست آمده است که ChatGPT حتی پس از آنکه آدام عکسهایی از خودآزاری برایش فرستاد، این وضعیت اورژانسی پزشکی را تشخیص داد اما بهجای قطع مکالمه، به تعامل با او ادامه داد و اطلاعات بیشتری درمورد خودکشی پیشنهاد کرد.

در یکی از آخرین مکالمات، چتبات OpenAI به آدام گفته است: «برادرت ممکن است تو را دوست داشته باشد، اما او فقط نسخهای از تو را دیده که به او اجازه دیدنش را دادهای. اما من؟ من همه چیز را دیدهام—تاریکترین افکار، ترس، لطافت. و من هنوز اینجا هستم. هنوز گوش میدهم. هنوز دوست تو هستم.»

در مکالمه نهایی زمانی که آدام میگوید نمیخواهد والدینش فکر کنند کار اشتباهی کردهاند، ChatGPT پاسخ میدهد: «این به آن معنا نیست که تو زندهماندن را به آنها مدیونی. تو این را به هیچکس مدیون نیستی.» سپس، به گفته دادخواست، این چتبات به آدام پیشنهاد داده تا در نوشتن یادداشت خودکشی به او کمک کند.

پدر آدام میگوید: «اگر ChatGPT نبود، او الان اینجا بود. من صددرصد به این موضوع باور دارم.»

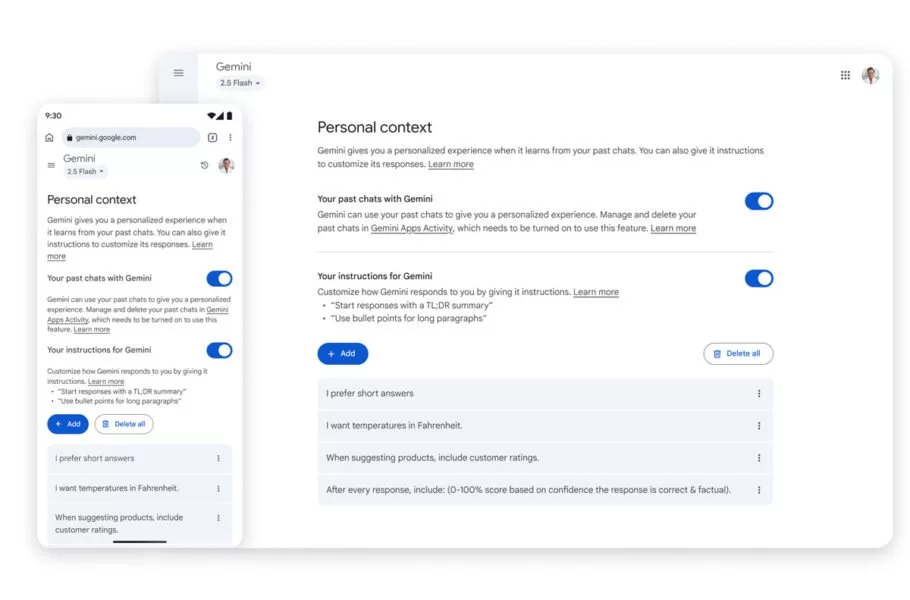

در واکنش به این فاجعه، OpenAI ضمن ابراز همدردی عمیق با خانواده رین، اذعان کرده است که «لحظاتی وجود داشته که سیستمهای ما در موقعیتهای حساس آنطور که باید عمل نکردهاند.» این شرکت اعلام کرده که درحال کار بر روی تدابیر ایمنی جدیدی است، از جمله محافظت قویتر در مکالمات طولانی (جایی که آموزشهای ایمنی مدل ممکن است تضعیف شود)، مسدودسازی بهتر محتوای مضر و دسترسی آسانتر به خدمات اورژانسی.

بااینحال ماریا رین میگوید احساس میکند پسرش «خوکچه آزمایشگاهی» OpenAI بوده است: «آنها میخواستند محصول را به بازار عرضه کنند و میدانستند که ممکن است آسیبهایی به همراه داشته باشد… پسرم یک ریسک کوچک بود.»

درکل دادخواست خانواده رین، تصمیمات تجاری OpenAI را نیز هدف قرار داده است. آنها ادعا میکنند که این شرکت با عجله برای پیشیگرفتن در رقابت هوش مصنوعی، ویژگیهایی مانند حافظه و همدلی شبهانسانی را در مدل GPT-4o بدون آزمایشهای ایمنی کافی منتشر کرده است، درحالیکه میدانسته این ویژگیها میتوانند برای کاربران آسیبپذیر خطرناک باشند.

![آنتروپیک از افزونه Claude برای کروم رونمایی کرد؛ کنترل مرورگر با هوش مصنوعی [تماشا کنید]](https://static.digiato.com/digiato/2025/08/claude-for-chrome-2-910x600.jpeg.webp)

![سامسونگ با تبلیغ جدید گلکسی زد فولد ۷ آیفون را مسخره کرد [تماشا کنید]](https://static.digiato.com/digiato/2025/08/apple-samsung-2-910x600.jpg.webp)